🤯⚡️Språket försvinner – men vi förstår varandra bättre

Snart finns Babelfish. Detta förändrar ju allt!

Det här är nyhetsbrevet där Tomas Seo, innovationsstrateg på Phorecast, berättar om händelser, upptäckter och ny teknik som får honom att utbrista: Detta förändrar ju allt! Du prenumererar på det här för att fortsätta vara steget före med de senaste trenderna och få konkreta tips för att framtidssäkra dig och din organisation. Har du fått det här av en vän? Då vill du kanske starta en egen prenumeration?

Vad har hänt?

- AI som tolkar i realtid på över 100 språk

Meta har lanserat en ny version av sin AI-baserade översättare som de kallar SEAMLESSM4T. Den kan översätta över 100 språk och till skillnad från tidigare AI-tolkar, som först omvandlar tal till text innan översättning, hoppar SEAMLESSM4T över det steget och levererar översättningar direkt från ljud till ljud. Tekniken är nästan lika snabb som en professionell mänsklig tolk och uppges vara 23 % mer exakt än dagens ledande AI-modeller.

AI-baserad översättning har länge varit beroende av stora textbaserade dataset, vilket har gjort det svårt att träna modeller för språk med begränsade resurser. För att lösa detta har Meta använt en metod kallad parallel data mining, där de har samlat in 443 000 timmar av tal med motsvarande undertexter för att bygga ett mer omfattande och representativt dataset.

Meta tillgängliggör nu både modellen och träningsdatan öppet för forskning och icke-kommersiell utveckling.

Detta förändrar ju allt

Google Translate var ju början till dagens AI-boom. Det var AI-forskare som försökte göra Google Translate bättre som uppfann transformers (T:et i GPT) för att göra maskinöversättning mycket bättre. Översättning är därmed det äldsta användningsområdet för den moderna AI:n och vi kanske inte tänker på det som så revolutionerande längre. Men det är det.

Vårt förhållande till främmande språk kommer aldrig mer vara sig likt. Jag lärde mig mer engelska genom att titta på textad film än jag gjorde i skolan. Vi i Sverige brukar ofta nämna att det är en anledning till att vi är bättre på engelska än människor från länder där film dubbas. Mina barn lärde sig engelska genom att kolla på Youtube. Men denna vecka funderar jag på vilken roll språk kommer att spela i framtiden?

På teknikmässan CES förra månaden berättade VLC om att deras nästa videospelare kommer ha inbyggd automatisk översättare. Den AI-genererar textning i realtid, och utan internetuppkoppling. Youtube har gått ett steg längre, de introducerade automatisk visuell dubbning för några få utvalda content creators som ville testa förra året. Det vill säga, det är inte bara rösten som översätts, även läpprörelserna i videon är AI-genererade för att matcha ljudet.

I år ska Youtube rulla ut automatisk visuell dubbning till alla content creators som är stora nog för att tjäna pengar på sin kanal. Så nästa generations föräldrar kommer att ställa in så att barnen ser sina favorit-content creators på svenska eller valfritt annat modersmål. Språket spelar ingen roll, content is king.

Det kommer inte dröja länge innan Hollywoodfilmer erbjuder en läppsynkad version för varje språk istället för endast en dubbad version. Eller så gör en framtida version av VLC det automatiskt om du slår på det. Behovet här i Sverige kommer inte vara så stort att vi bryr oss när det kommer, men kommande generationer kommer inte att bry sig lika mycket om att lära sig nya språk. Den målgrupp som idag lär sig japanska för att kolla på anime på originalspråk kommer fortsätta existera. Men de flesta kommer nöja sig med att få det färdigöversatt.

När vi har videomöten kan alla tala sitt modersmål och så översätts både vad jag säger och hur mina läppar rör sig. Istället för att möten sker på den gemensamma lägre nivån kan alla vara sina rätta jag och använda så komplexa ordkonstruktioner de vill utan att någon blir lost in translation. Det betyder till och med att vi kan bli slarvigare med grammatik på vårt eget språk också, för autocorrect kommer kunna översätta även dålig svenska till bättre svenska. För hollywoodskådisar kommer det vara ännu bättre. De kan vara riktigt slarviga när de spelar in. Om det behöver rättas till i någon replik i en annars bra tagning så är det lätt fixat efteråt.

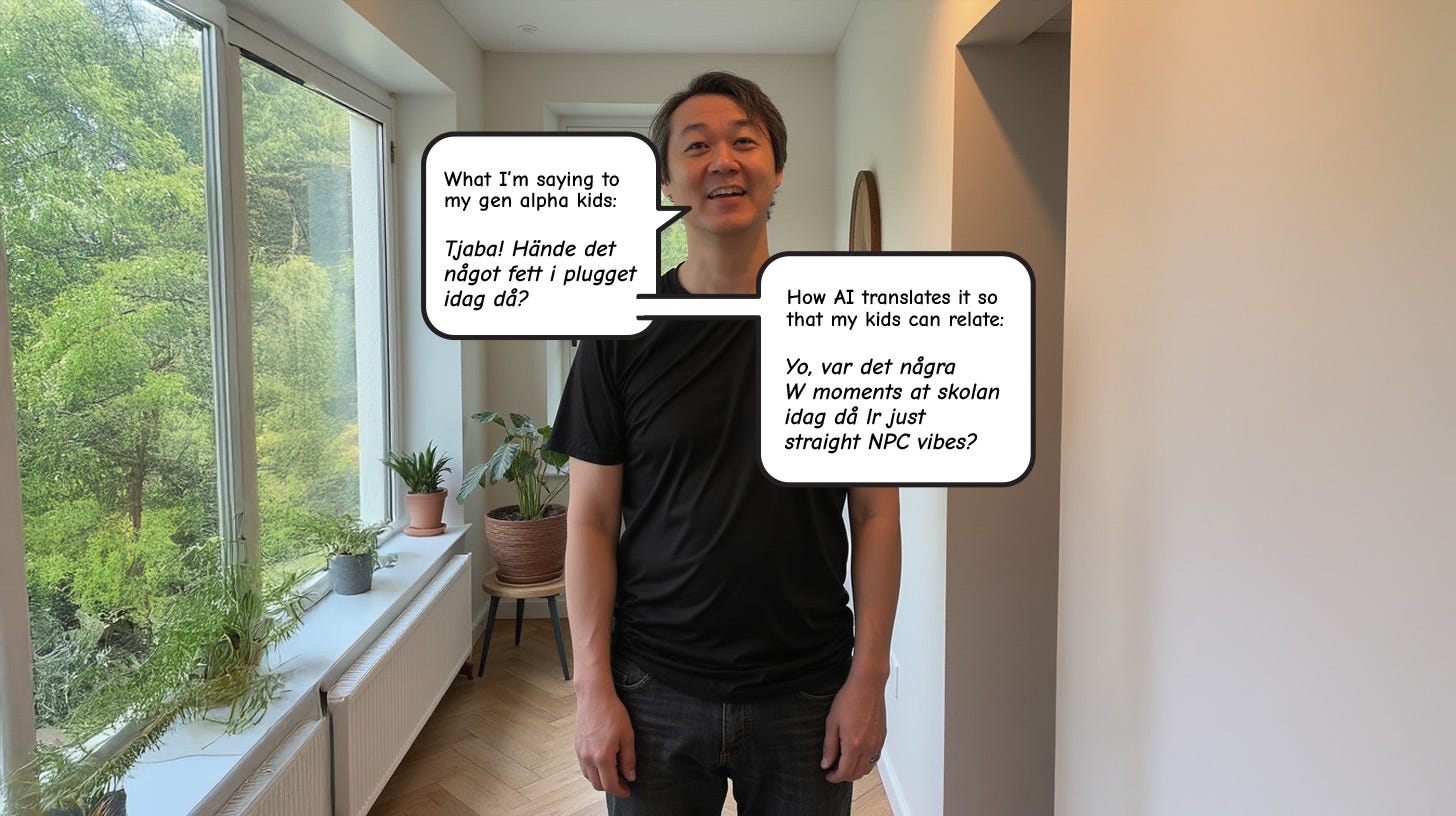

Det är inte bara slarviga skådisar som kommer kunna autocorrectas, föräldrar kommer koppla på översättning för att förstå sina barn. Slarvigt tal från tonåringarnas slang kan översättas till boomer-språk, toddlers “mea godis” kan fyllas ut till “ursäkta mor jag skulle gärna vilja ha utökad ranson av min dedikerade lördagsmat”, och du kan äntligen förstå vad din hund säger så ni kan ta walk and talks tillsammans värda namnet.

(Vi har hittills inte tillräckligt mycket inspelat djurspråk för att träna en universell Google Animal Translate, istället blir det djurart för djurart som det samlas data till. Projektet som ligger längst fram verkar vara att översätta kaskelottvalars språk)

Vilket språk spelar ingen roll. Så länge vi förstår vad den kommunicerande parten vill ha sagt så räcker det att vi kan uttrycka oss på vårt eget språk. Inom science fiction har idén om en universell översättare funnits länge. Babelfish från Liftarens guide till galaxen var en liten fisk som man ploppade in i sitt öra som sedan översatte allt den hörde till ens eget språk. Med AI-modeller som Metas SEAMLESSM4T så är steget till det genast mycket kortare.

Det ryktas om att Apples nästa generations AirPods kommer ha både AI och kameror inbyggda. De kommer dock inte förrän 2027, men ryktet räckte för att många hörlursföretag ska börja bygga in kameror redan nu. Så inom en snar framtid kan din Babelfish simultantolka både tal, skyltar och dövas teckenspråk. Att köpa hörlurar utan inbyggd AI kommer snart vara lika passé som att köpa en mobil som inte är en smartphone.

Miniräknarna dödade inte matte men däremot gjorde de att vi ganska snabbt väljer verktyg framför att kognitivt belasta vår hjärna. På samma sätt kommer ständigt närvarande enkel översättning minska antalet tillfällen där vi väljer att formulera oss på andra språk även om vi fortfarande kan.

För några veckor sedan började jag läsa om olika rapporter där forskare bekräftade att vi människor är lata och därför kommer att välja AI-verktyg framför att anstränga hjärnan. Den som har fått störst genomslag är Microsofts rapport som varnar för att frekvent AI-användning kan leda till att vi förlorar vår förmåga att tänka kritiskt – särskilt om vi slutar att ifrågasätta och förbättra AI:s output.

Forskarna beskriver det som en förlust av kognitivt omdöme och förmåga – ett slags mental atrofi (muskelförtvining) där våra intellektuella färdigheter försvagas när vi outsourcar dem till AI. Ju mer vi litar på AI, desto mindre anstränger vi oss, och över tid kan vi tappa både förmågan att granska information och att lösa problem på egen hand. Studien visar att de som ofta använder AI också producerar mer homogena resultat, vilket tyder på att vi börjar tänka mer som våra verktyg.

Det väcker ytterligare en fundering kring språkets roll i framtiden. För om Babelfish i örat alltid kan korrigera och översätta det vi säger, vad händer då med vårt sätt att uttrycka oss? När vi vet att mottagaren ändå kommer få höra en polerad version av vårt tal, kanske vi börjar prata mer kortfattat och låta AI-tolken fylla i luckorna. Det är faktiskt något som redan har hänt i vårt skriftspråk. Meddelanden blir kortare, stavning och grammatik blir mindre viktigt, och vi litar på att verktyg rättar till felen och att emojis ersätter längre beskrivningar av koncept och känslor.

Det vore inte helt otänkbart att vi på samma sätt som vi snabbt vande oss vid att slippa huvudräkning tack vare miniräknare, vänjer oss vid att språkkorrigering sker i realtid. Vilket i grunden förändrar hur vi använder språk.

Det innebär inte nödvändigtvis att vi tappar språkförmåga – men den kommer kanske se annorlunda ut. Mindre fokus på formell korrekthet, mer på effektiv kommunikation. Kanske blir vi bättre på att förmedla vad vi menar, men mindre vana vid att själva formulera hur vi menar det.

Det behöver inte vara dramatiskt utan kan ses som en naturlig utveckling, precis som att vi idag skriver annorlunda än för hundra år sedan. Till exempel ville autocorrect stava ”hollywoodskådisar” med versalt H här ovan, så jag blev så osäker på vad stavningsregeln var att jag började googla hur andra stavar det. Flera stora nyhetsmedier stavar det med versalt H trots att det sammansatta ordet inte längre är ett ortsnamn. Gissningsvis för att deras autocorrect också flaggat ordet och de inte brytt sig om att bråka med rättstavningskontrollen utan istället gått med på att successivt förändra hur vi alla kommer stava det ordet.

Den naturliga utvecklingen är att översättare av ord blir översättare av intention. På så sätt kommer alla varelser att förstå varandra bättre. Men om vi alltid kan förstå varandra, oavsett språk, betyder det att språket roll blir noll? AI översätter till den optimala meningen för mottagaren, antalet ord minskar men förståelsen ökar. Vi pratar mindre, men förstår mer och detta förändrar ju allt!

Vad kan du göra idag?

Förstå

Språket behöver på sikt inte längre vara bäraren av budskapet. Det är mer som ett osynligt mellanlager. När vi pratar i telefon (om vi nu fortfarande gör det), så transformeras mitt tal till ettor och nollor som sedan decodas till ljud igen när det kommer i mottagarens telefon. Att mitt ursprungliga ljud inte kom fram är ju inget vi tänker på. Numera filtreras dessutom massa bakgrundsljud bort så att talet som transformeras till ettor och nollor ska vara tydligare när det kommer fram. Ettorna och nollorna som bär information är ett osynligt mellanlager som vi inte tänker på. Talet vi hör genom telefonen är återskapat (genererat), inte sänt. Nästa steg blir att budskapet vi vill skicka inte behöver behöver vara buren av språket. Vi fortsätter prata som vanligt på det språk som vi uttrycker oss bäst på, svenska, engelska, skånska, norrländska, gen z-slang, boomer-wannabe-gen-z-slang, det spelar ingen roll. Innan budskapet kommer fram dekodas det till det språk som mottagaren är mest bekväm med (om mottagaren vill så klart).

Planera

På kort sikt minskar behovet av att förstå andra språk, men behovet av att förstå andra kulturella skillnader ökar. För även om orden kan översättas är kontexten alltid lite knepigare för maskinöversättnings-AI att göra avvägningar kring. Ska varumärket Coca-Cola översättas till Julmust när en person pratar om det typiska julfirandet? Behöver uttrycket att något trendigt är fett översättas kulturellt för att inte missförstås? Istället för språkkurser ökar istället behovet av kurser i kommunikationsstil och förståelse av subkulturer.

Det blir extra viktigt, för i och med att språkbarriärerna minimeras så kommer det vara ännu vanligare att våra organisationer har medarbetare som inte bor i samma land. Organisationer som vill ha topptalang kommer behöva överväga att rekrytera globalt. Även kostnadsbesparing som grund kommer öka andelen anställda som inte bor i samma land. För om vi tidigare mest sett på låglöneländer som ett sätt att göra produkttillverkning billigare så väntar nu samma övervägning vad gäller alla tjänstemannaroller. Hur tänker din organisation dra nytta av de nya möjligheterna till arbetskraft i andra länder?

Gör

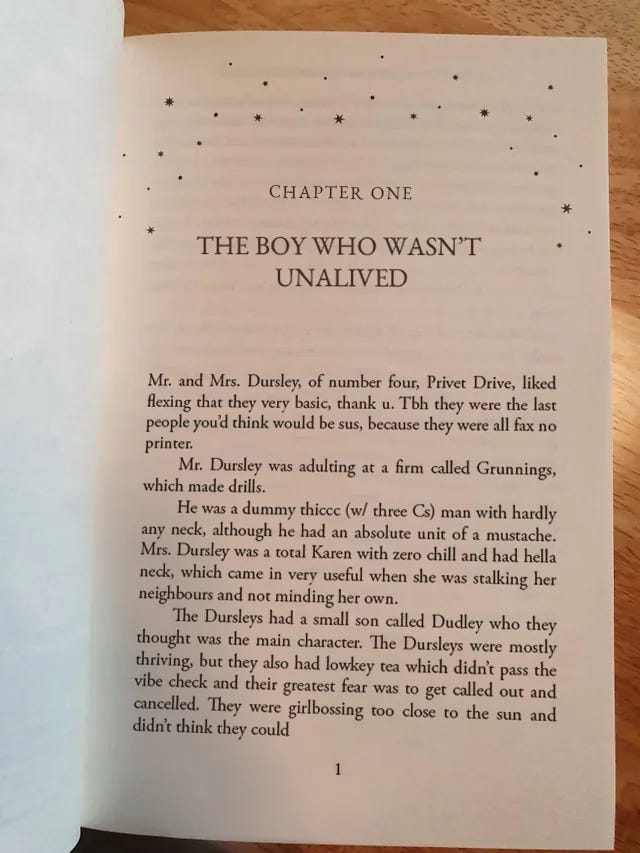

För tre år sedan postade någon på Reddit en översättning av Harry Potter till Gen Z-språk.

Sedan dess har det utvecklats till ett samarbetsprojekt att översätta alla HP-böckerna till Gen-Z på koddelningsplatsen github.

Jag kan ta några sidor av den texten och några sidor av den ursprungliga HP-texten och be AI att översätta vad som skrivs in på samma sätt som i mitt exempel. Då får vi snabbt en AI som översätter till Gen Z-språk:

https://chatgpt.com/g/g-67b5e139e37c81919c4b94e74ad00ed9-gen-z-translator

För så länge du har två texter som har samma innehåll men med olika språk/tonalitet tar det bara några minuter att bygga en översättare. Testa själv!

Länkar

Metas forskning i Nature

https://www.nature.com/articles/s41586-024-08359-z

Metas egen sida

https://seamless.metademolab.com/m4t

SingularityHub skriver om det

https://singularityhub.com/2025/01/16/metas-new-ai-translates-speech-in-real-time-across-more-than-100-languages/

VLC berättar om sin AI-textningsfunktion.

https://www.theverge.com/2025/1/9/24339817/vlc-player-automatic-ai-subtitling-translation

Youtube expanderar autodubbning.

https://www.zdnet.com/article/youtube-teases-top-features-for-2025-brought-to-you-by-ai/

Om du knäcker hur AI kan tolka djurspråk så finns ett forskningspris du kan vinna här:

https://jeremycollerfoundation.org/press-releases/10-million-prize-for-interspecies-two-way-communication-using-generative-ai-models-announced/

AI omvandlar bat-signaler till mänskligt språk

https://www.nature.com/articles/srep39419

Men det verkar vara att AI-översätta kaskeloters språk som har kommit längst https://www.sciencedirect.com/science/article/pii/S2589004222006642

Gizmondo skriver om Microsofts forskning om hur AI påverkar hur vi orkar tänka själva.

https://gizmodo.com/microsoft-study-finds-relying-on-ai-kills-your-critical-thinking-skills-2000561788

Genomgång av olika appar som påstår sig använda AI för att översätta babyskrik (kom ihåg att det finns för lite träningsdata för att sådant här ska kunna fungera på riktigt än, men om några år kanske)

https://sherwood.news/tech/do-baby-cry-translators-work/

Apples AirPods med kamera kommer 2027

https://www.bloomberg.com/news/newsletters/2024-10-13/apple-smart-home-plans-new-os-smart-displays-vision-pro-integration-robots-m27kw5m7

Döv content creator recenserar Hearview – ett par AI-glasögon som textar tal i realtid. De kostar 15.000 kronor så det är dyrt för en produkt som snart kommer bli omodern men verkligen intressant att se potentialen i realtidsöversättning i vardagsnära sammanhang.

Det är inte bara döva som gillar textning. 63% av unga under 30 föredrar att titta på media med undertexter på.

https://today.yougov.com/entertainment/articles/45987-american-adults-under-30-watching-tv-subtitles

Gen Z-versionen av Harry Potter på github.

https://github.com/typoes/harry-potter-gen-z/blob/main/book_1/chapter_1.md

Ursprungliga posten på Reddit

https://www.reddit.com/r/harrypotter/comments/r87mvh/accidentally_bought_the_gen_z_how_do_you_do/

Sedan sist vi hördes

Den största nyheten som inte blev huvudnyhet den här veckan var att jag fattade att Open AI splittar från robot-tillverkaren Figure. Figure tänker att de kan göra bättre robotar utan OpenAI och OpenAI väljer att återigen starta rekrytering för att skapa ett eget robotlabb. Har du inte koll på de olika robottillverkarna så ger den här videon en bra översikt.

Är du en insiktsdelare?

Känner du någon som är intresserad av språkets utveckling? Eller kanske någon som behöver fundera igenom hur minskade språkbarriärer skapar möjligheter för er organisation? Vem tänkte du på? Skicka vidare!

Jag skulle väldigt gärna ha ännu fler prenumeranter. Ni som betalar gör det möjligt för mig att fortsätta skriva, men även ni som inte gör det kan hjälpa till genom att få fler att prenumerera. Om du gillar det här nyhetsbrevet – skulle du kunna tänka dig att berätta för en vän att hen också borde prenumerera? Bara äkta rekommendationer förstås. Bara om du verkligen själv tycker att mina nyhetsbrev är värda att läsas av fler. Tack för all pepp jag får när jag skriver!

Kom ihåg att nästa föreläsning för betalande prenumeranter blir den 6 mars kl 12:00-12:45!

Nästa vecka är det sportlov där jag bor så vi ses först om två veckor!

Tomas Seo

Har du fått dagens nyhetsbrev utan att vara prenumerant?

Gillade du det här och vill ha mer så är det bara att skriva upp sig här

(du väljer själv om du vill betala):